在人工智能技术飞速发展的时代背景下,芯片作为计算能力的核心载体,正在经历一场前所未有的技术革命。传统芯片与AI芯片之间的界限越来越清晰,它们在设计理念、架构特点和应用场景上存在着根本性的差异。本文将深入探讨AI芯片与普通芯片的本质区别,揭示这一技术变革背后的深层逻辑。

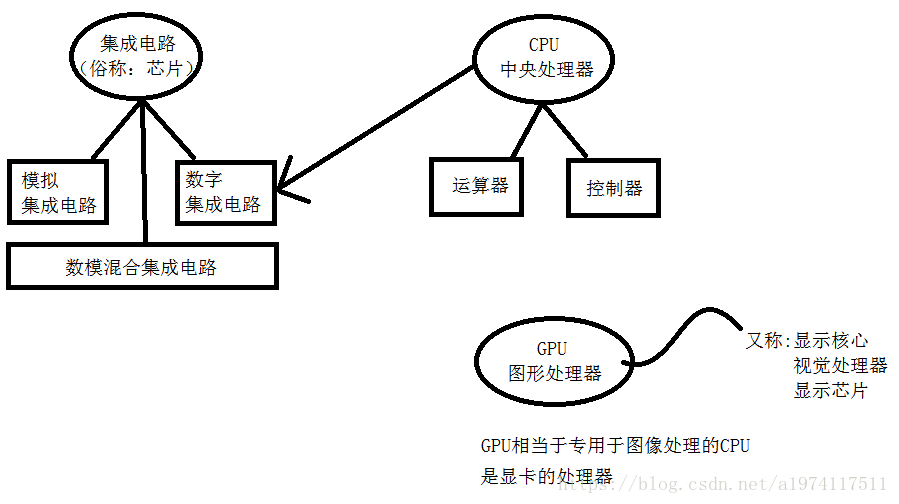

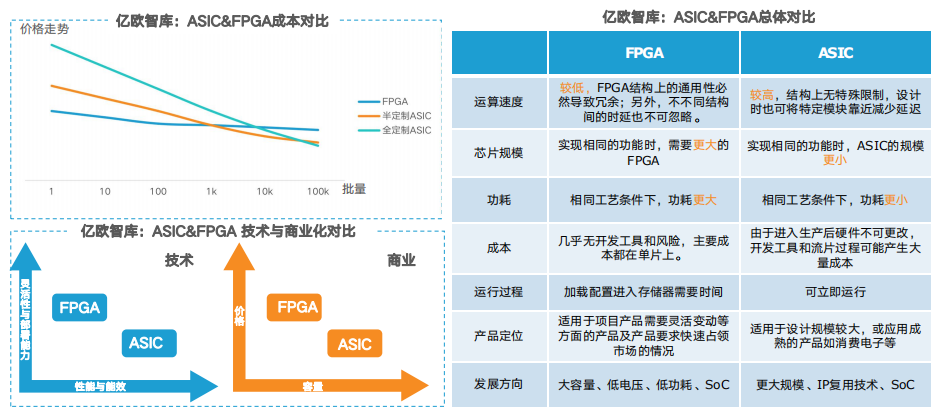

传统芯片,包括CPU(中央处理器)和GPU(图形处理器),主要基于冯·诺伊曼架构设计。这种架构的核心特点是将存储器和处理器分离,通过总线连接进行数据传输。传统芯片采用通用计算模式,旨在处理各种类型的任务,包括办公软件、游戏、多媒体处理等通用应用。

CPU作为传统计算的核心,采用流水线作业的方式,通过复杂的控制逻辑和缓存机制来优化单线程性能。其架构设计重点在于平衡各种计算类型,实现顺序执行和并行处理的协调统一。GPU虽然具备一定的并行计算能力,但主要是为了处理图形渲染任务而优化,通过大量简单处理单元来加速图形计算。

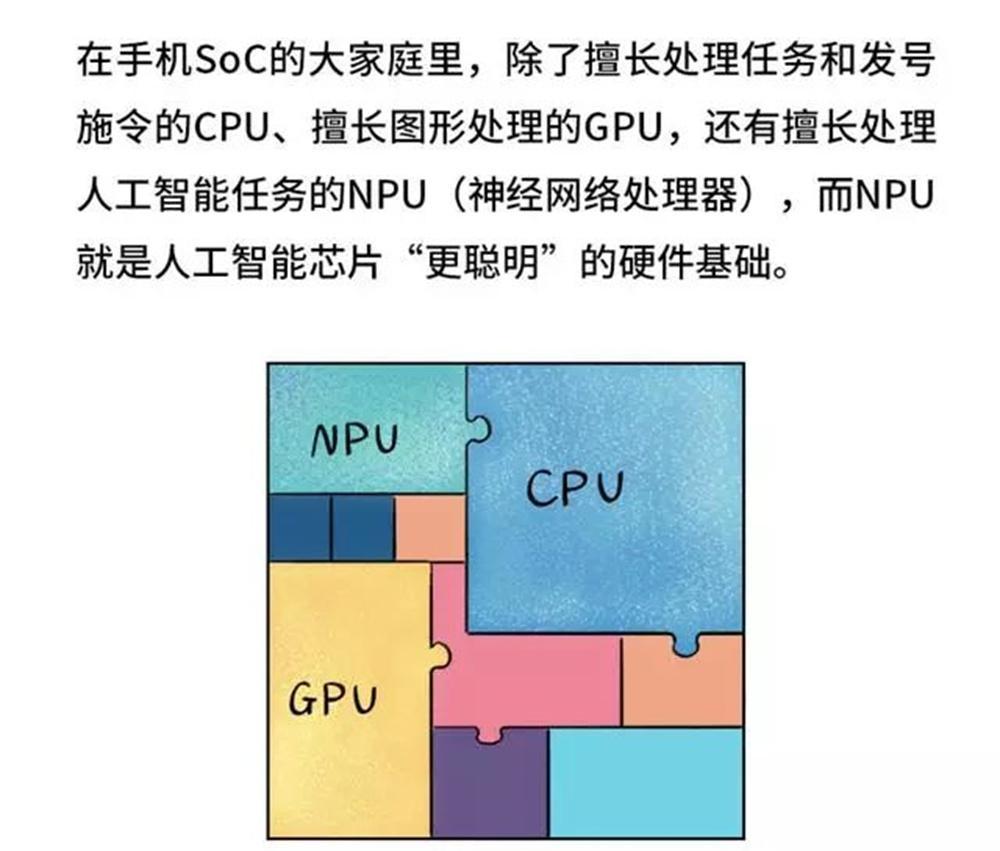

AI芯片的出现标志着计算技术的一次重大突破。这些专用芯片从零开始设计,专门针对人工智能计算的特点进行优化。AI芯片包括多种类型,主要有NPU(神经网络处理器)、TPU(张量处理单元)、DPU(数据处理单元)等,它们共同构成了AI时代的基础设施。

NPU(Neural Processing Unit)代表了AI芯片设计的最高水准。它摒弃了传统冯·诺伊曼架构的局限性,采用存储与计算一体化的设计理念。在NPU架构中,数据存储和处理单元紧密集成,通过突触权重直接实现信息的存储和计算功能,大幅减少了数据在处理器和存储器之间的传输开销。

NPU的并行计算能力是其最大的技术优势。与传统CPU的指令级并行不同,NPU专注于数据级并行,能够同时处理大量的矩阵运算和向量操作。这种设计完全契合深度学习算法的核心需求,因为神经网络的基础运算就是大规模的矩阵乘法。

TPU(Tensor Processing Unit)是Google开发的专业AI芯片,专门为机器学习工作负载优化。TPU的设计更加聚焦于张量计算,通过专门的硬件单元来处理多维数组运算。这种专门化的设计使得TPU在特定类型的AI任务中表现出色,特别是在大规模模型的训练和推理过程中。

传统芯片采用控制驱动的计算模式,依赖复杂的指令集和分支预测机制来处理不同的计算任务。而AI芯片则采用数据驱动的计算模式,专注于特定类型的大规模数据运算。这种差异体现在多个方面:

并行度差异:传统CPU主要依赖指令级并行,通过流水线技术提升性能。GPU虽然在图形渲染中采用大规模并行,但仍然是基于图形的计算模式。AI芯片则采用高度并行化的设计,能够同时处理数千个甚至数万个计算单元,非常适合神经网络的并行计算需求。

内存访问模式:传统芯片的内存访问模式相对灵活,支持随机访问和各种复杂的数据结构。AI芯片则采用高度优化的内存访问模式,通过本地存储和缓存优化来减少内存访问延迟,最大化计算单元的利用率。

数据精度处理:AI芯片通常支持低精度计算(如8位、16位整数),这在AI推理任务中能够显著提升性能,同时保持足够的精度。相比之下,传统芯片主要针对高精度浮点计算进行优化。

AI芯片在能效比方面展现出压倒性优势。以典型的NPU为例,其功耗相比同等的传统芯片可以降低数倍到数十倍。这种优势主要源于以下几个方面:

尽管AI芯片在特定领域展现出强大性能,但传统芯片仍然在许多场景中发挥着不可替代的作用:

通用计算任务:办公软件、网页浏览、数据库操作等日常应用仍然主要依赖CPU的强大单核性能和复杂逻辑处理能力。

多任务协调:操作系统管理、进程调度、系统监控等需要复杂控制逻辑的任务,CPU的设计优势依然明显。

实时系统:工业控制、汽车电子等领域对实时性和可靠性要求极高,传统的确定性执行模式仍然不可替代。

深度学习训练:大规模神经网络的训练需要处理海量的矩阵运算,AI芯片的并行计算能力使其成为不二之选。

边缘AI推理:在智能手机、IoT设备等边缘计算场景中,AI芯片能够以低功耗实现实时AI推理功能。

云计算加速:在数据中心环境中,AI芯片为机器学习、推荐系统、自然语言处理等AI服务提供强大的计算支持。

未来的计算架构正朝着异构计算的方向发展,不同类型的芯片将协同工作,发挥各自优势。CPU负责通用控制和复杂逻辑处理,GPU承担大规模并行图形计算,AI芯片专门处理神经网络计算任务。这种协同模式将最大化整体系统的性能和能效。

随着制程工艺逐渐接近物理极限,传统的"摩尔定律"面临挑战。存算一体化架构作为突破这一限制的重要路径,正在成为芯片设计的重要方向。AI芯片在这一领域的先行探索,为未来计算架构的发展指明了方向。

AI芯片的发展不仅是硬件技术的突破,更需要软件生态的配合。深度学习框架、编译器优化、算法适配等软件层面的优化,将充分发挥AI芯片的性能潜力。

AI芯片与传统芯片的差异反映了计算技术发展的深刻变革。从通用的冯·诺伊曼架构到专用的神经网络架构,从控制驱动到数据驱动,从单一计算到异构协同,这些变化不仅仅是技术细节的调整,更代表着计算范式的根本性转移。

随着人工智能技术的持续发展,AI芯片将在更多领域发挥重要作用。然而,传统芯片并不会被完全取代,而是与AI芯片形成互补关系,共同构建更加智能、高效的计算生态系统。理解这两种芯片的本质差异,有助于我们更好地把握技术发展趋势,为未来的技术决策提供科学依据。

在这场计算技术的变革中,AI芯片代表着面向未来的发展方向,而传统芯片则承担着稳定基础的重要职责。只有充分理解它们的差异与联系,才能在技术选择和应用部署中做出最优决策,推动人工智能技术的健康发展。